放送局におけるAI技術の検討事例【Connected Media TOKYO 2019レポート】

編集部

2019年6月12日〜14日の3日間、千葉県・幕張メッセにて、マルチスクリーン・クラウド・ビックデータなどデジタルメディア分野における技術を集めたカンファレンス『Connected Media TOKYO 2019』が開催され、全期間で15万人を超える来場者を記録した。今回はこの中から、6月13日に開催された専門セミナー『放送局におけるAI技術の検討事例』をレポートする。日本テレビ放送網株式会社 技術統括局 技術戦略統括部 主任の加藤大樹氏と同社技術統括局 デジタルコンテンツ制作部 副主任の篠田貴之氏が登壇し、同社の番組制作の現場におけるAI(人工知能)技術の具体的な活用事例が紹介された。

■ロードレース中継制作現場でのAI活用

最初に篠田氏が、駅伝中継現場におけるAIの活用事例を紹介した。

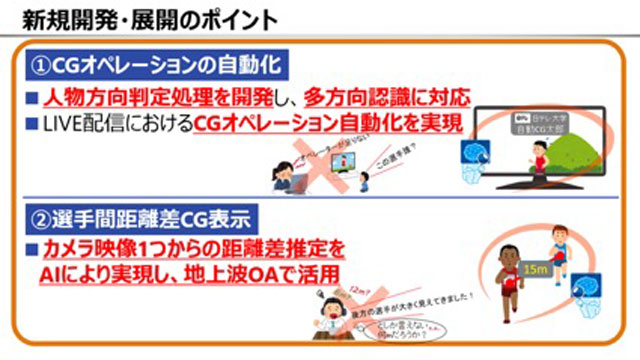

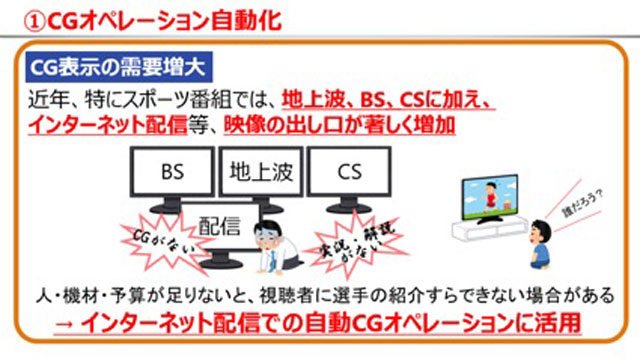

ロードレース中継は、走行選手たちの氏名やラップタイム(走行時間)、所属チームごとの順位など、リアルタイムに入れ替わるさまざまな情報がテロップ挿入されるのが特長だ。これまでスタッフの人力によって行われてきたこれらのオペレーション工程を、AI技術を用いることによって自動化することに成功したという。

篠田氏は具体例として、現在走っている選手たちの下に走行時間や氏名などを表示する「ラップタイムCG」におけるAIの活用法を紹介した。これまでは選手たちに並走する中継車からの映像をスタッフが目視し入力していたが、「画面に誰が映っているか」を高精度で判定する「画像認識技術AI」の導入により、自動的に選手を判定してテロップを出すことが可能となった。また、選手間の距離についても、中継車のカメラ映像からAIが自動的に推定し、リアルタイムに作画したCGを地上波で活用した。

AIによる自動CGオペレーションにより、人手不足問題の解消のほか、インターネット配信における新たなコンテンツ発信にも乗り出しているという。コース上の各地点に設けた定点カメラでレースの模様を配信する「定点カメラLIVE」配信にて、選手230名分のテロップをAIにより、自動挿入した。

篠田氏ら開発チームは、過去に行われた膨大な量の中継映像を学習データとして使用し、AI認識における精度向上に努めたという。一般的に人物判定を行う際には顔のみで認識することが多いが、ロードレースのような過酷な競技では、疲労による表情の変化やサングラスの着用等の影響により、識別が困難なシーンが多い。「各大学のユニフォームを学習させた方が、より高い精度での識別が行え、さらに毎年出場選手が変わるので、運用面での効率も良い」と篠田氏は語った。

沿道に設置され、観客や並走車両などが多数映り込む定点カメラにおいては、独自の「観客除去フィルタ」を導入し、認識率を向上させた。

「沿道に立ち止まっている観客は、画面上では選手の向きと逆の方向に移動するため『選手ではない』と判別するようにした。選手と並走する関係者や白バイなどもひとつの『チーム』として学習させ、削除するようにした」(篠田氏)

CGの自動生成のみならず、これまで通りの番組制作のフローを支援する取り組みもAIによって行われているという。

たとえば、激しく入れ替わる選手たちの順位の把握について、AIによって推定された変動を自動で可視化し、確認できるようにしたほか、インカムによる音声通話でやりとりされるスタッフ間のやりとりも音声認識によって自動でテキスト化。目視でも確認できるようにすることで、連絡漏れや認識違いを防ぐ仕組みを構築した。

このほか、AIによるダイジェスト動画の生成についての取り組みも行い、これまで人手では限界のあった細やかな対応への可能性も見えてきたという。

■「誤報は許されない」報道現場でのAI活用

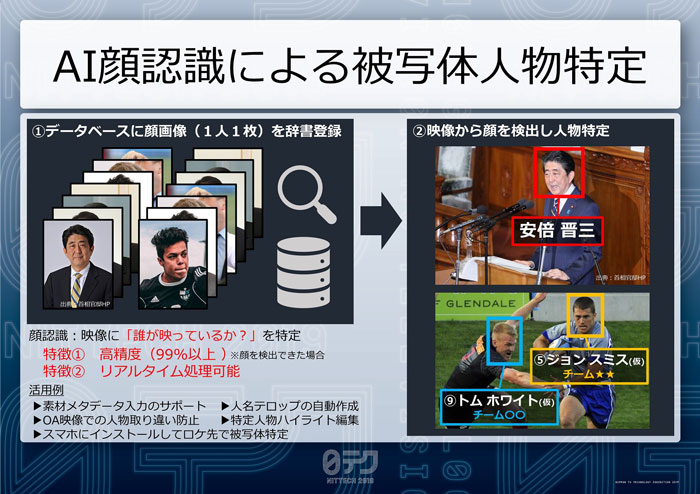

つづいて加藤氏が、報道制作現場におけるAIの活用事例を紹介。顔認識技術を用いて99%以上の高精度を実現する「AI顔認識による被写体人物特定」や、放送で使用されたニュース原稿をWEBサイトの記事用に自動で要約・リライトする「AIによるニュース原稿自動要約」が事例として挙げられた。

「AI顔認識による被写体人物特定」は、報道番組における被写体の取り違えを防止する観点から研究が進められてきた技術。

「日テク2019」展示より

「日テク2019」展示より画面に映った人物の取り違えは情報そのものの正確性だけでなく、社会的に与える影響も甚大なものとなる。「どの素材にどの人物が映っているか」という情報は重要なメタデータとして扱われ、これまで人手によって入力されてきたが、この入力を正確かつ効率的に行なうため、株式会社東芝、東芝デジタルソリューションズ株式会社との共同で研究が進められている。

「番組制作の現場で技術を使用する際に求められるのは、『99%以上の高精度であること』『リアルタイム処理できること』『学習データとして使用できる画像が1人1枚でもよいこと』。人間による顔認識(被写体特定作業)の一般的な精度は97%程度と言われており、誤報を防止する観点からも高精度であることは必須。処理のリアルタイムについても、緊急性の高い素材を扱ったり、オンエア前の素材を迅速に処理したりする必要がある。また、番組制作のワークフロー的に大量の学習データを用意することは難しく、1人につき1枚しか学習データがない場合でも対応できる必要があった。これらの分野で技術を持っている東芝と共同で開発を行っている」(加藤氏)

今後、実証実験として、被写体取り違え防止の実現や被写体メタデータの入力サポートのほか、番組二次利用時の権利処理など制作以外の用途への応用や、クラウド、スマホアプリなどへの展開に取り組んでいく方針という。

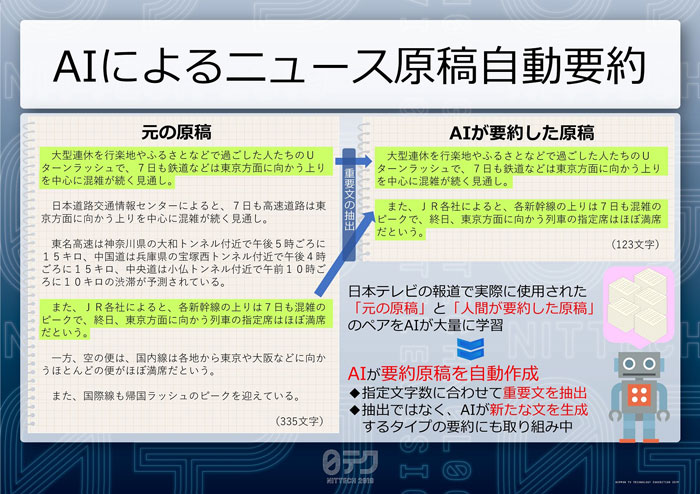

『AIによるニュース原稿自動要約』は、同社が運営するニュース専門メディア『日テレNEWS24』の現場において研究されている技術だ。

「日テク2019」展示より

「日テク2019」展示より同チャンネルでは、CSや地上波での放送用に執筆されたニュース原稿をもとにWEBサイト上でもその内容を要約した記事を配信している。現在は専門のスタッフによって人力で要約・入力が行われているが、その特殊性から熟練に少なくとも1〜2年を要する高度な技術が求められ、かつ人力では記事の作成に少なくとも数分〜数十分程度の時間を要していた。

これまでも自動要約の技術そのものは存在していたが、これらは単語や文の頻出度や類似度をもとにしており、前後の文脈が重要となるニュース原稿としては不自然な文章が生成されてしまう問題があった。

そこで同社では、これまでの報道で実際に使用されてきたニュース原稿と、これをもとに人間が要約した原稿のペアを大量に学習。株式会社NTTドコモとの共同開発により、原稿要約のノウハウをルールベースで実装した。

「具体的なルールは『最初の文(リード文)に重要な情報が含まれていることが多い』『注意喚起系の内容や、具体的な数字を含むものは重要なことが多い』といったもの」(加藤氏)

加藤氏ら開発チームは、この仕組みをもとに文章の生成式を定義。これまでの「文書を分解する」要約ではなく、“日テレ報道式の文法”に沿ったかたちで「1からニュース原稿を生成する」新しいアプローチの要約技術を開発した。

現在は『日テレNEWS24』の現場において、実証実験をすすめている。将来的にはクラウドサービス化し、他社への展開なども視野に入れているという。

■AIによる自動化で「人間はクリエイティブなことに時間を割く」

セッションの締めくくり、番組制作現場におけるAI導入のメリットについて両氏は「AIにできることはAIに任せ、人間はクリエイティブな仕事に時間を振り分ける(ことができる)」と語った。

働き方改革が求められ、ワーク・ライフ・バランスの適正化が取り沙汰されるなか、ルーチンワークや作業量の多い項目をAIによって自動化させることで人間の時間的、体力的なリソースを節約し、これによって節約できた時間を用いてさらにクリエイティブな業務に注力する── 「AIによって人間の仕事は奪われるのか」という議論も起こるなか、「人間にしか出来ない仕事」への可能性をより活かすというアプローチだ。

まだ未知の領域が多いAIの分野だが、「『まずやってみる』が大事。取り組みを進めることよって知見が増え、新たなニーズと結びつく」と両氏は述べ、セッションが終了した。