テレビ局のAI活用で演出強化と効率化が実現~Interop Tokyo 2021~「テレビ局におけるAI活用事例」レポート

編集部

インターネットテクノロジーの最新動向とビジネス活用のトレンドを伝えていくイベント「Interop Tokyo 2021」が、4月14~16日にかけて千葉県・幕張メッセで開催。特別企画「Connected Media」では、放送業界の最先端の取り組みを紹介する専門セミナーが行われた。ここでは、民放4社による「テレビ局におけるAI活用事例」について紹介する。

登壇したのは、日本テレビ放送網 技術統括局 デジタルコンテンツ制作部の篠田貴之氏、テレビ朝日 IoTv局IoTvセンター 兼 技術局設備センターの胡子裕之氏、TBSテレビ ICT局システム開発部の武田侑祐氏、フジテレビジョン 技術局技術開発部の白坂典義氏。

■スポーツ中継を軸に積極的なAI活用を進める日本テレビ

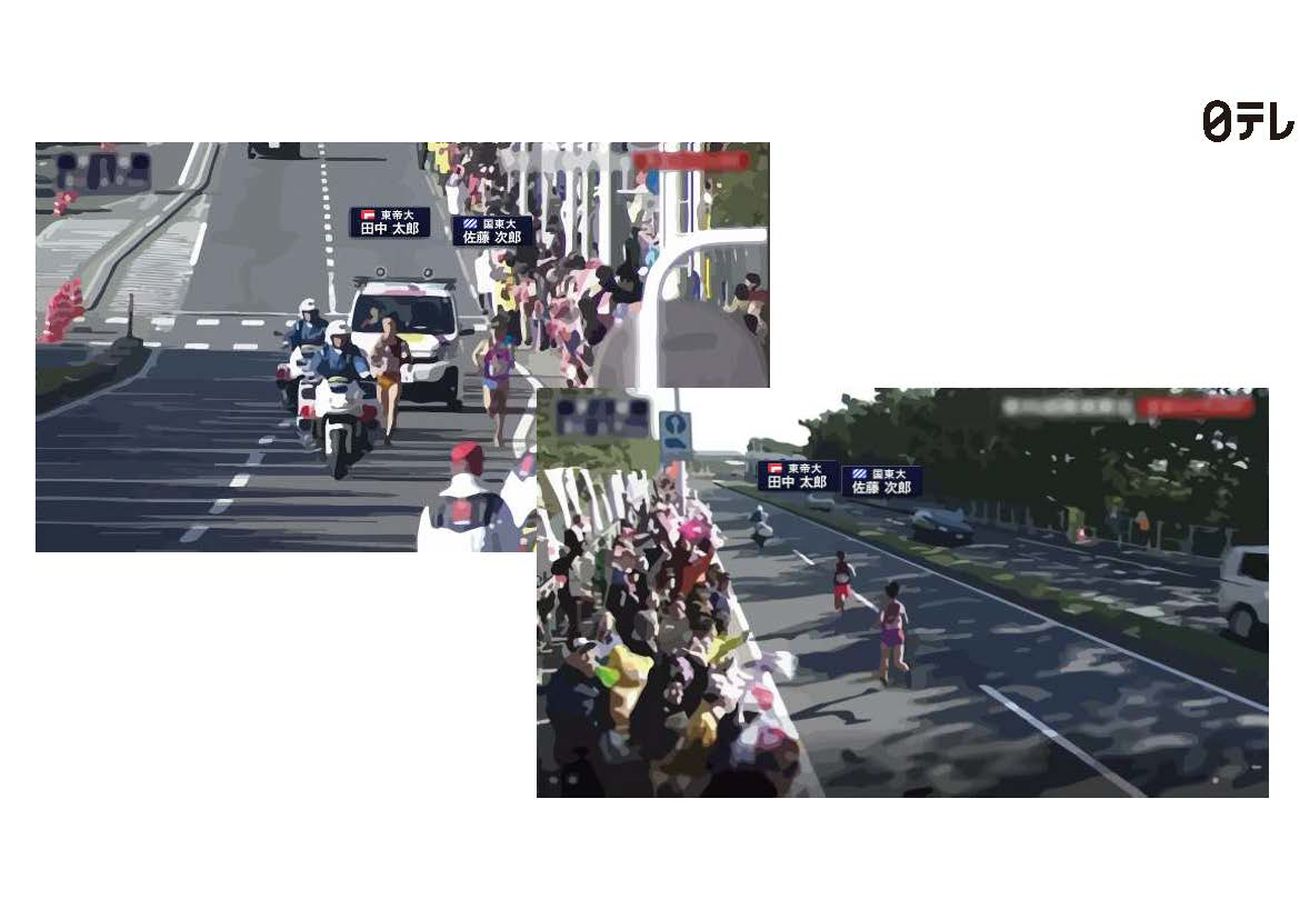

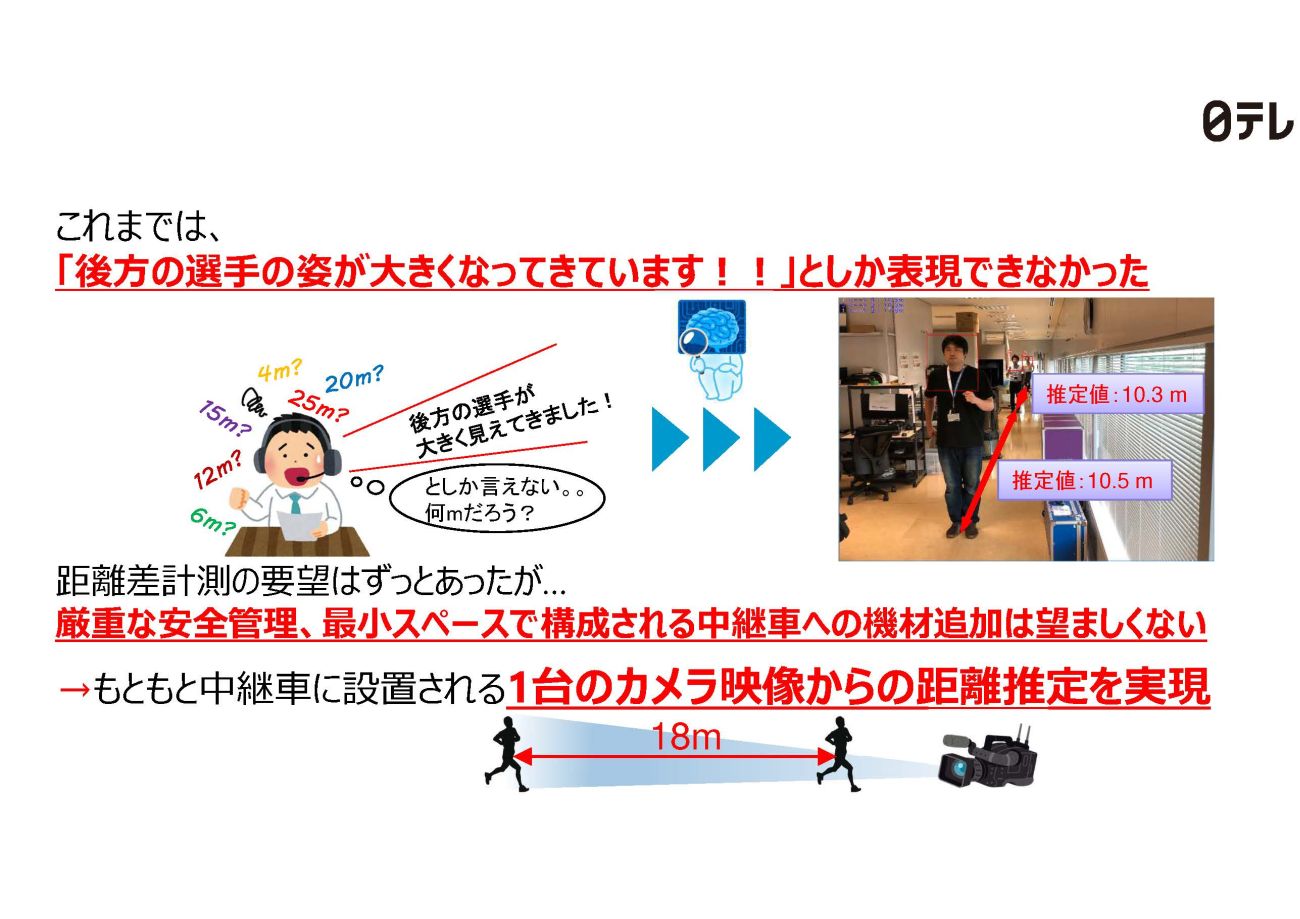

まず、日本テレビの篠田氏が、スポーツ中継におけるAI活用実例を紹介。2017年より、ロードレース中継で、走っている選手をAIで認識しチーム名などを表示させている。ロードレースでは、選手の顔を確実にカメラで捉えることが難しいため、ユニフォームを認識することで精度を上げた。そして、中継車搭載のGPSと連携することでラップタイムの計測を自動化。1台のカメラ映像から距離を測れるようにAIに学習させ、選手間の距離を表示するなどして、生中継に反映させている。

ラグビー中継では、選手の紹介CGを入れる際にAIを活用。AIがわずか0.2秒で顔認識を行い、すぐに選手の紹介CGを表示できるようになった。2019年のラグビーワールドカップでも採用し、認識ミスなどの問題は起きなかったという。

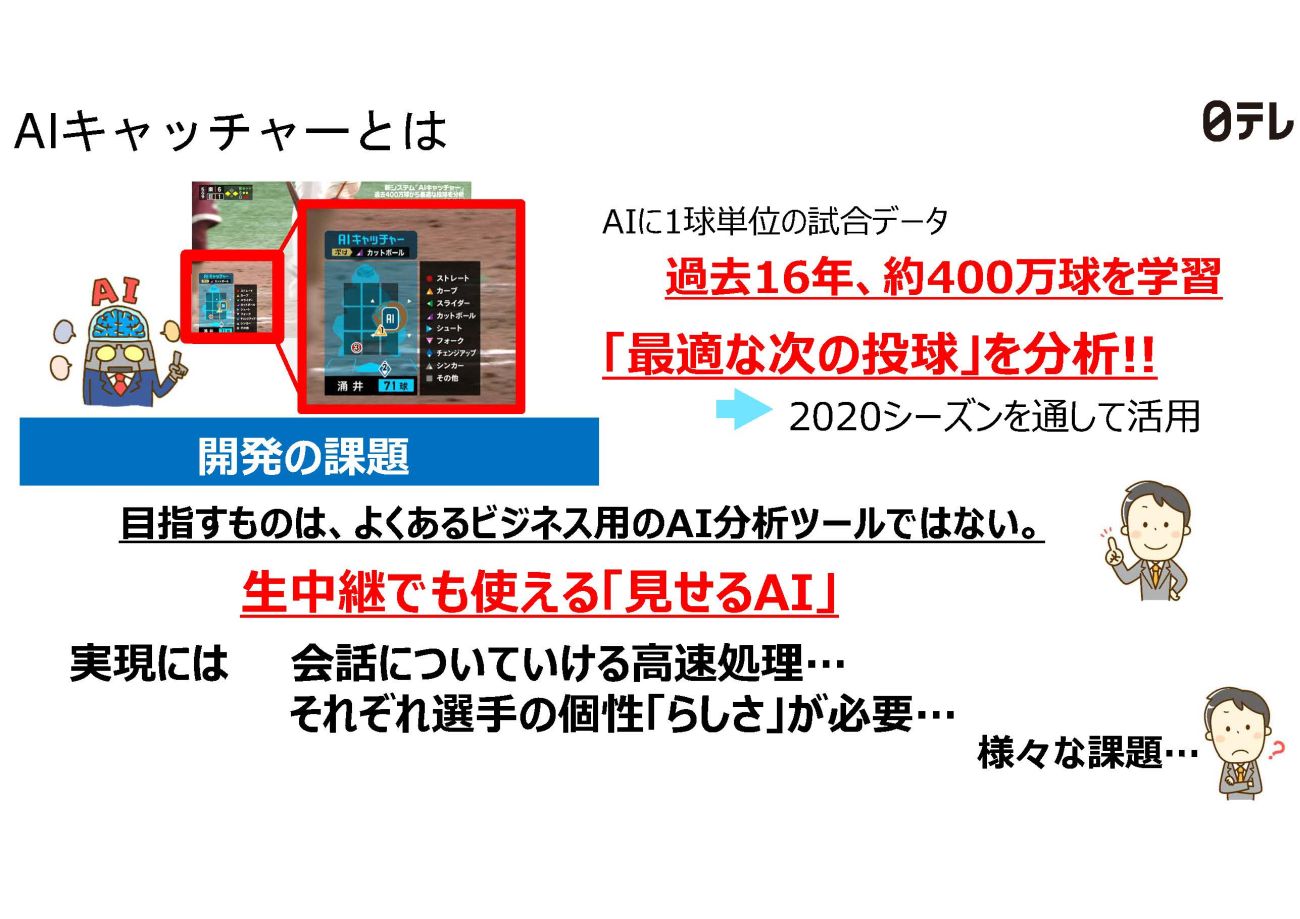

昨年からはプロ野球の生中継において、過去16年分、約400万の投球を学習させたAIキャッチャーが「次に何を投げれば良いのか」を分析し、その結果を画面上に表示。放送中のイニングに得点が入る確率を予測する「AI得点予測」も展開する。そのほかにも、ドラマと連動したチャットボット、キャプションや字幕制作、視聴率の予測にもAIを活用している。篠田氏は「番組の演出としても新しい手法を提供している」と、積極的なAI活用について語った。

■テレビ朝日の「リアルタイム文字マスク」は「民放テレビの長年の夢」

テレビ朝日の胡子氏は3つの事例を紹介した。まず「AI Video OCR」は、「AIモデル」からどのタイプのテロップが出ているかを瞬時に判断、「AI-OCR」(OCR→Optical Character Recognition/Readerの略で、カメラなどに映った文字やキャラクターを認識する技術)を利用し、選手名が表示されているエリアを読み取り、選手リストと照合 、1秒以内 に日本語選手名を上書きするシステム。

英語から日本語へ、選手名テロップの自動変換を可能にした。

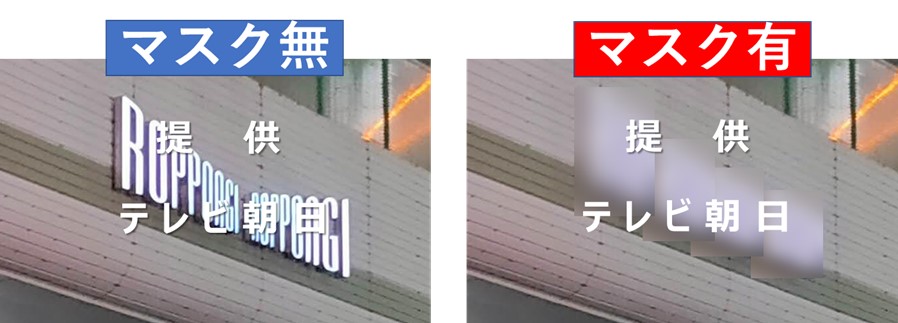

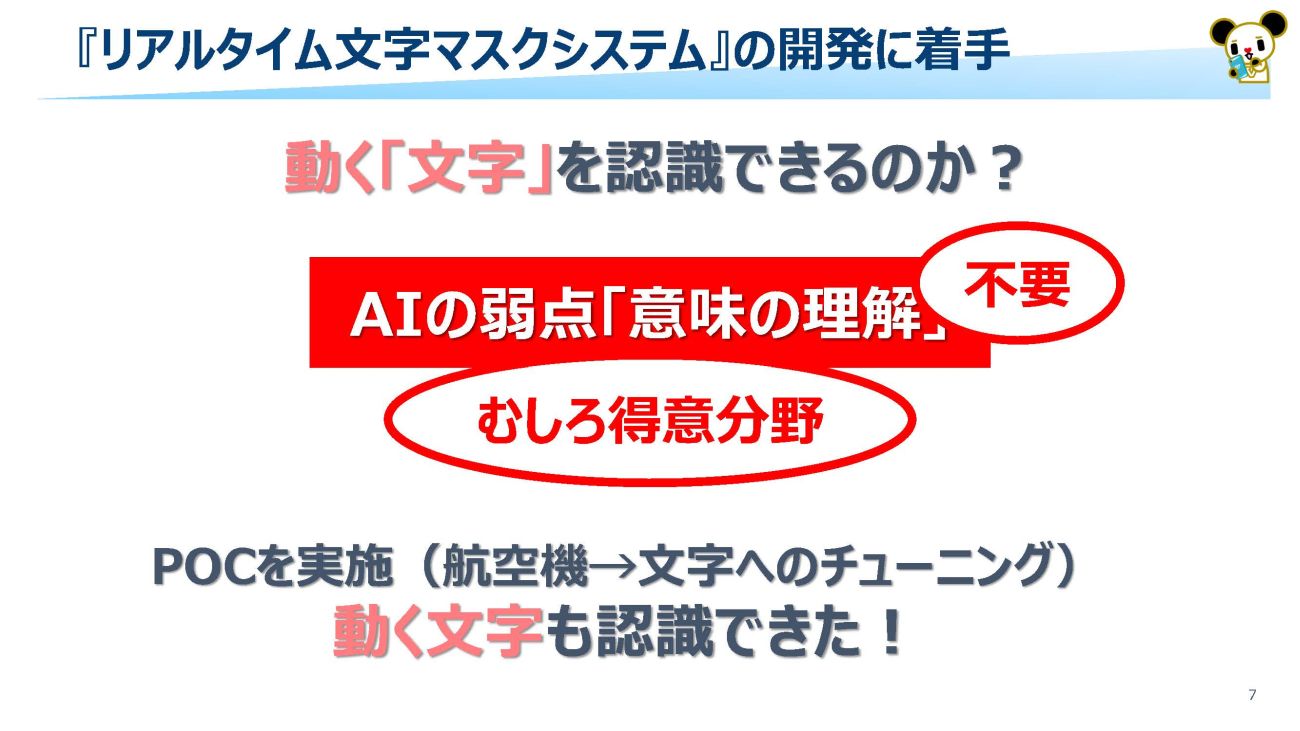

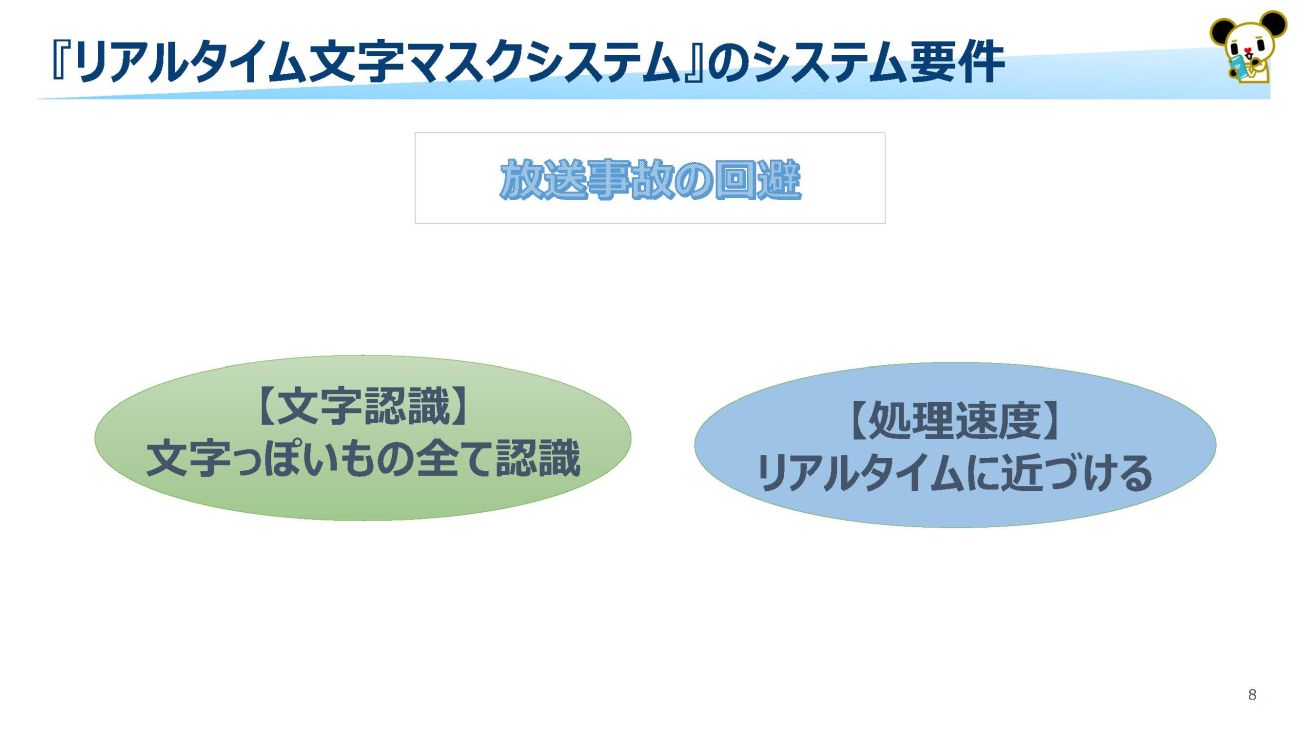

そして、胡子氏も開発に携わっているのが、同システムを使った「リアルタイム文字マスク」。これは提供クレジットの表示中に、背景に文字のようなものが映った場合にほぼリアルタイムで自動的にボカシをいれる機能。胡子氏は「この状態は、民放テレビにおいて不体裁とされ、テレビ朝日ではこの状態が1秒続くと放送事故の扱いになります」と、問題の大きさを説明。

特に生放送でこのようなボカシを瞬時にいれることはこれまで不可能とされていた。「生放送で瞬時にマスク処理をすることは、私たちテレビ朝日、ひいては民放テレビの長年の夢と言っても過言ではありません」と、民放テレビ業界全体の広告媒体としての価値向上の一助になると、このシステム開発の意義を語った。同局では、システム導入による放送事故抑止に期待しているという。

そのほか、約250万ある大量のアーカイブ素材から任意の人物の登場シーンを検索するシステム「AI顔認証で人物探し」を開発中。これまでは人の手で該当する素材を探していたが、このシステムが導入されれば、顔写真を入力するだけで抽出することが可能になる。現在、社内検証が続けられているという。

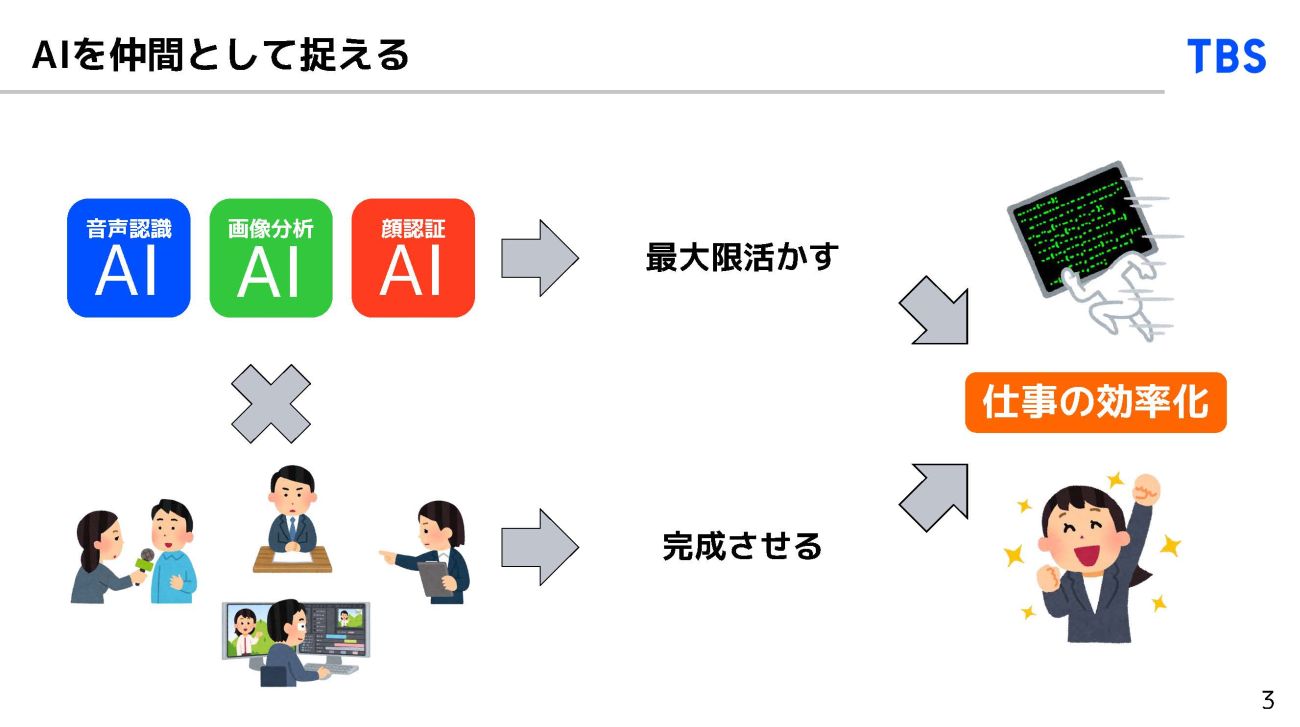

■「AIは仲間」すべてを任せるのではなく、一緒に完成させるというコンセプトのTBS

TBSの武田氏は、AI活用におけるコンセプトについて「AIも完璧ではないので、すべてを任せるのではなく、AIの得意なことを最大限に活かして仕事を進め、人間が仕事を完成させる」と語り、5つの事例を紹介した。

まず、音声認識AIによる文字起こしエディタの「もじこ」。例えば、ニュース番組において、記者会見やインタビューは文字起こしを行い、内容を精査したうえで編集を行っていく。しかし、これには膨大な時間が奪われていた。「もじこ」では、音声認識AIが自動的に文字起こしを行い、認識ミスは人の手で修正することで完成とする。なお、「もじこ」は、一般向けにも公開されている。

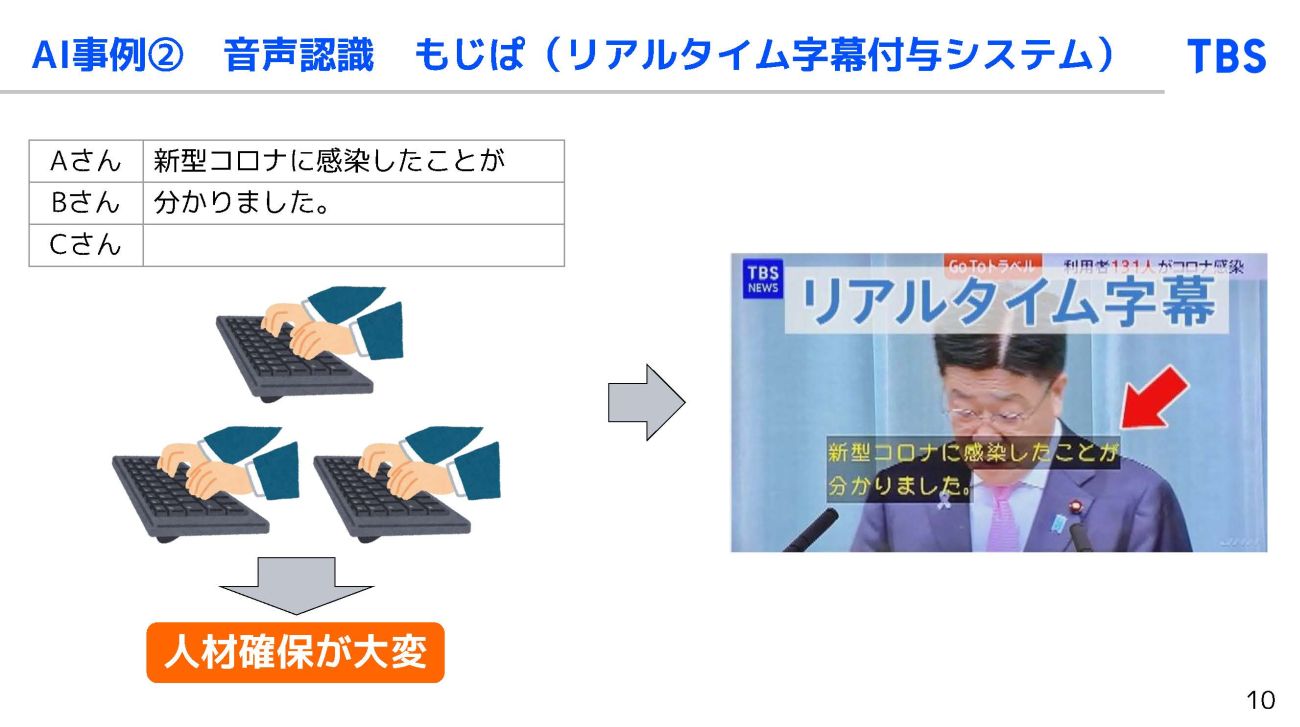

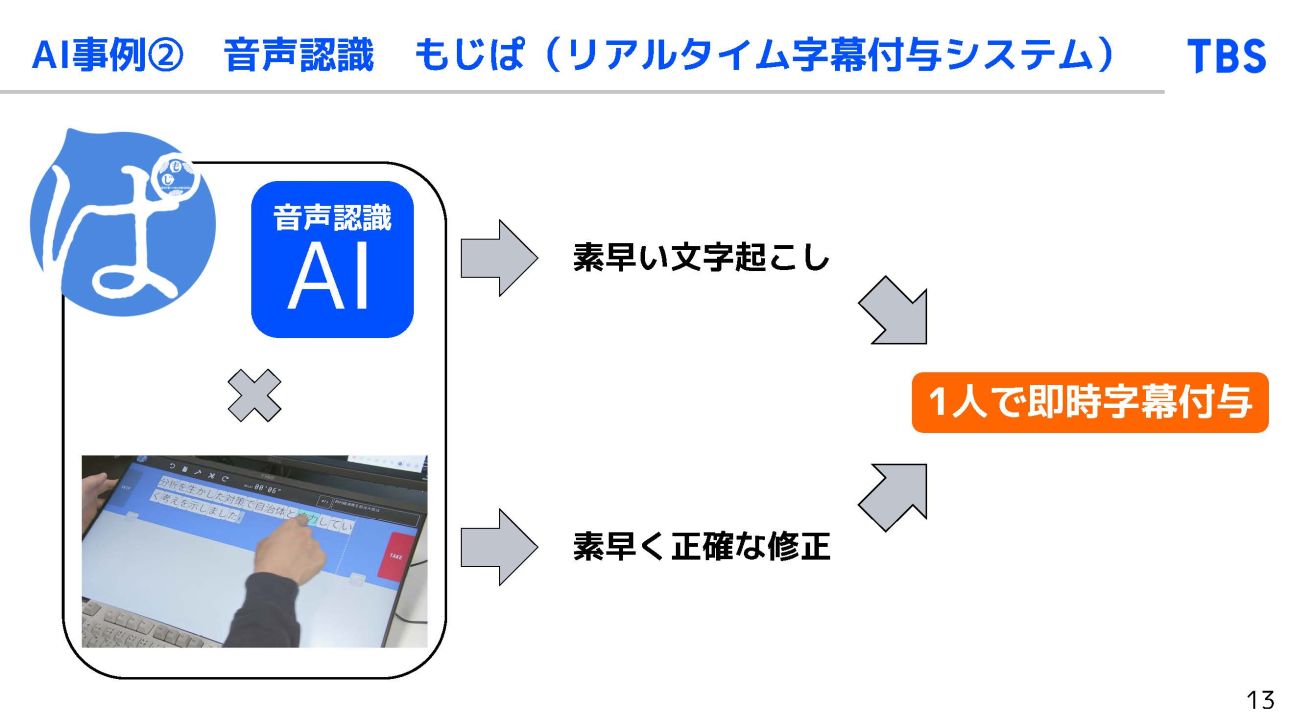

リアルタイム字幕付与システム「もじぱ」は、同じく音声認識AIを利用して聴覚障がい者の方などに向けて生放送の番組に字幕を付けるもの。AIが高速で文字起こしを行い、人が間違いを修正・反映していく。通常、リアルタイム字幕付与は複数人での作業が必要だが、これにより1人でオペレーションすることが可能になる。

そして、画像認識AIも活用。権利処理が必要なモノの映り込みをチェックする「映り込み情報検出システム」は、チェック人数を従来の4人体制から削減。開発中の「スポンサー提供被り検出システム」は、提供テロップと番組テロップの文字が重なっていないかをチェック。そして、顔認証AIを活用した「かおたん」は、何台ものカメラで撮影した収録映像から、特定の出演者が映っているシーンを探し出すことができる。いずれも間違いの減少や編集時間の短縮を実現している。

■AI利活用の方向性を、アプリ開発を通じて模索するフジテレビ

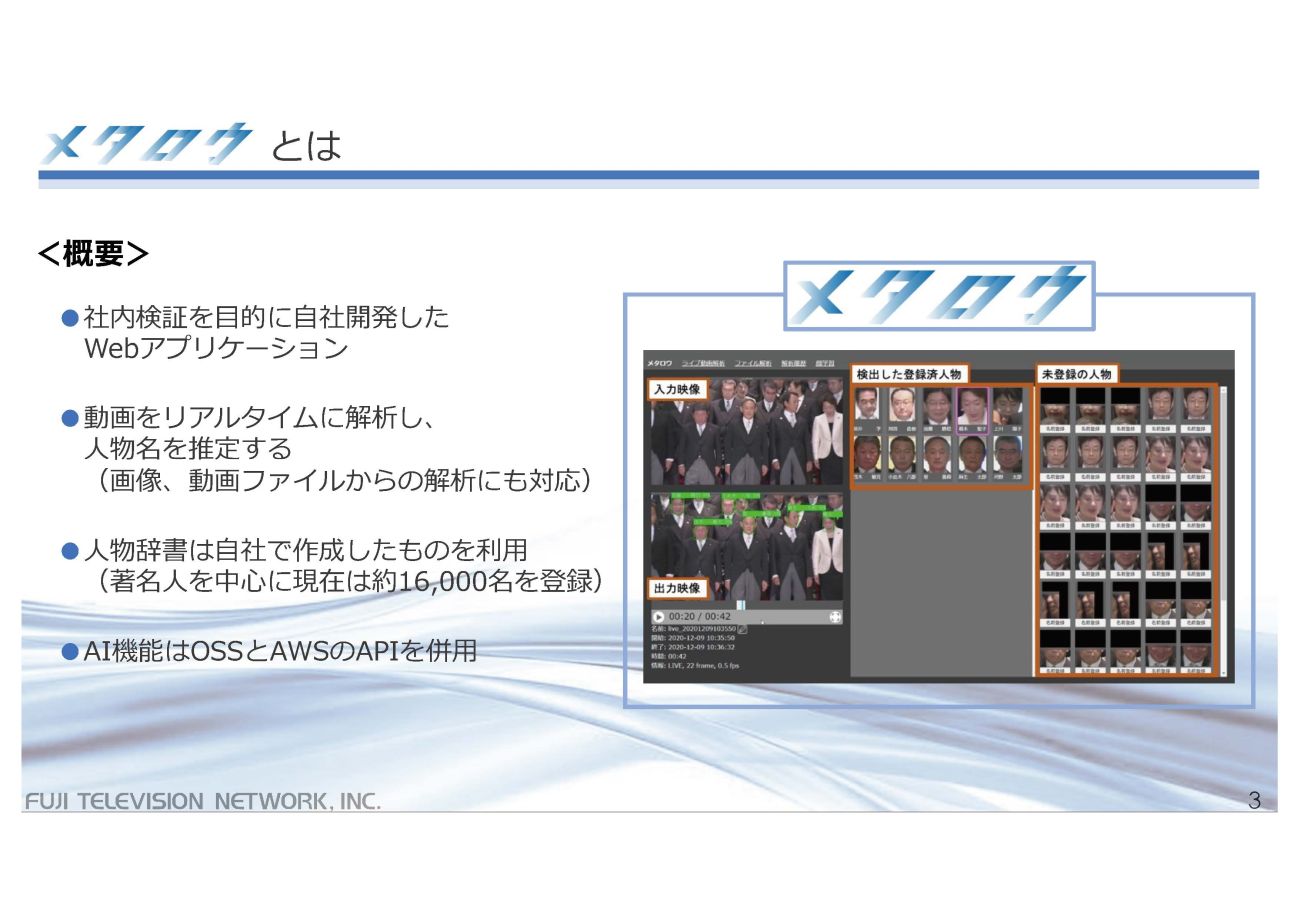

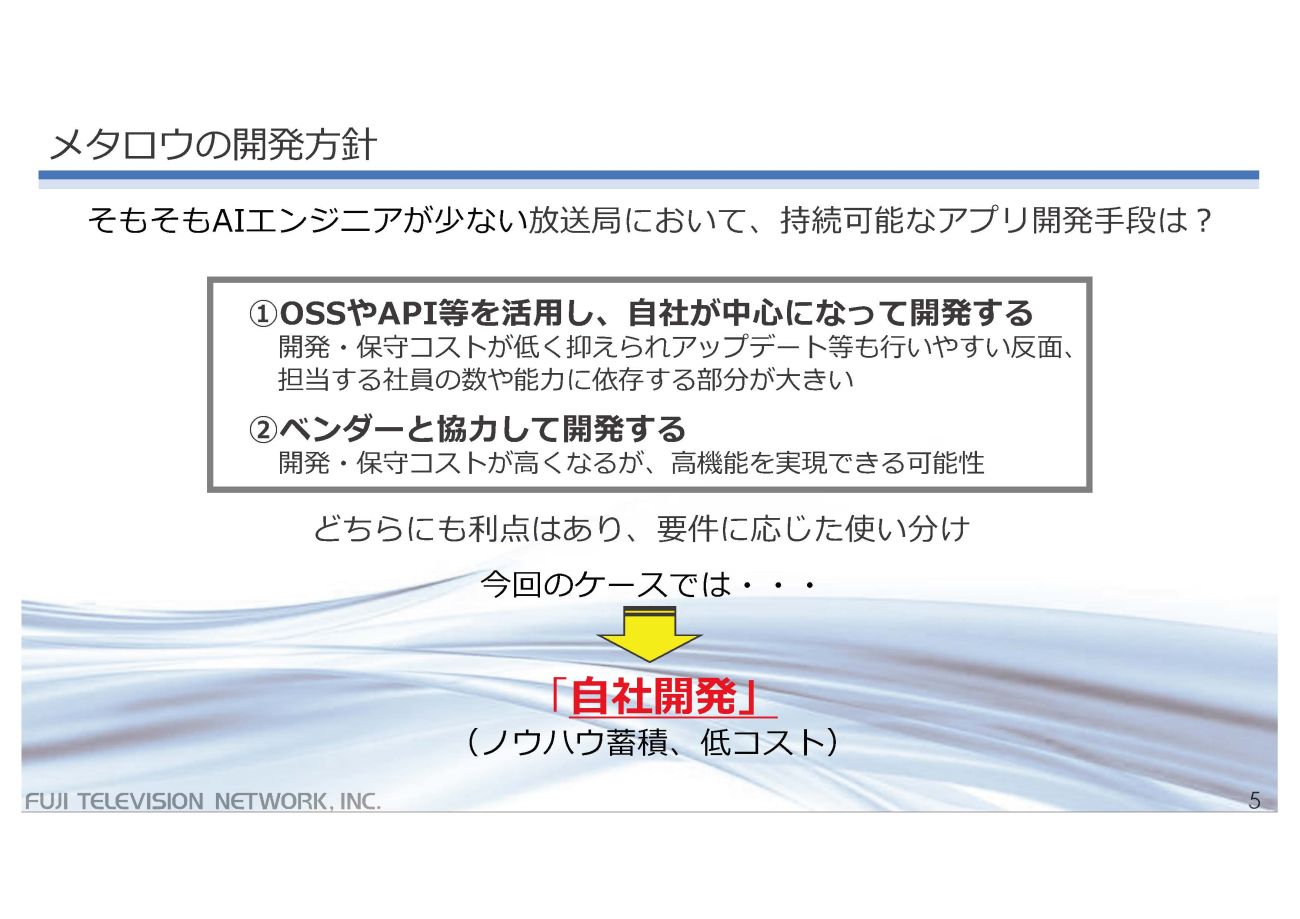

フジテレビの白坂氏は、AIを利用した人物名推定のWebアプリケーション「メタロウ」を軸とした、AI利活用の方向性について報告した。

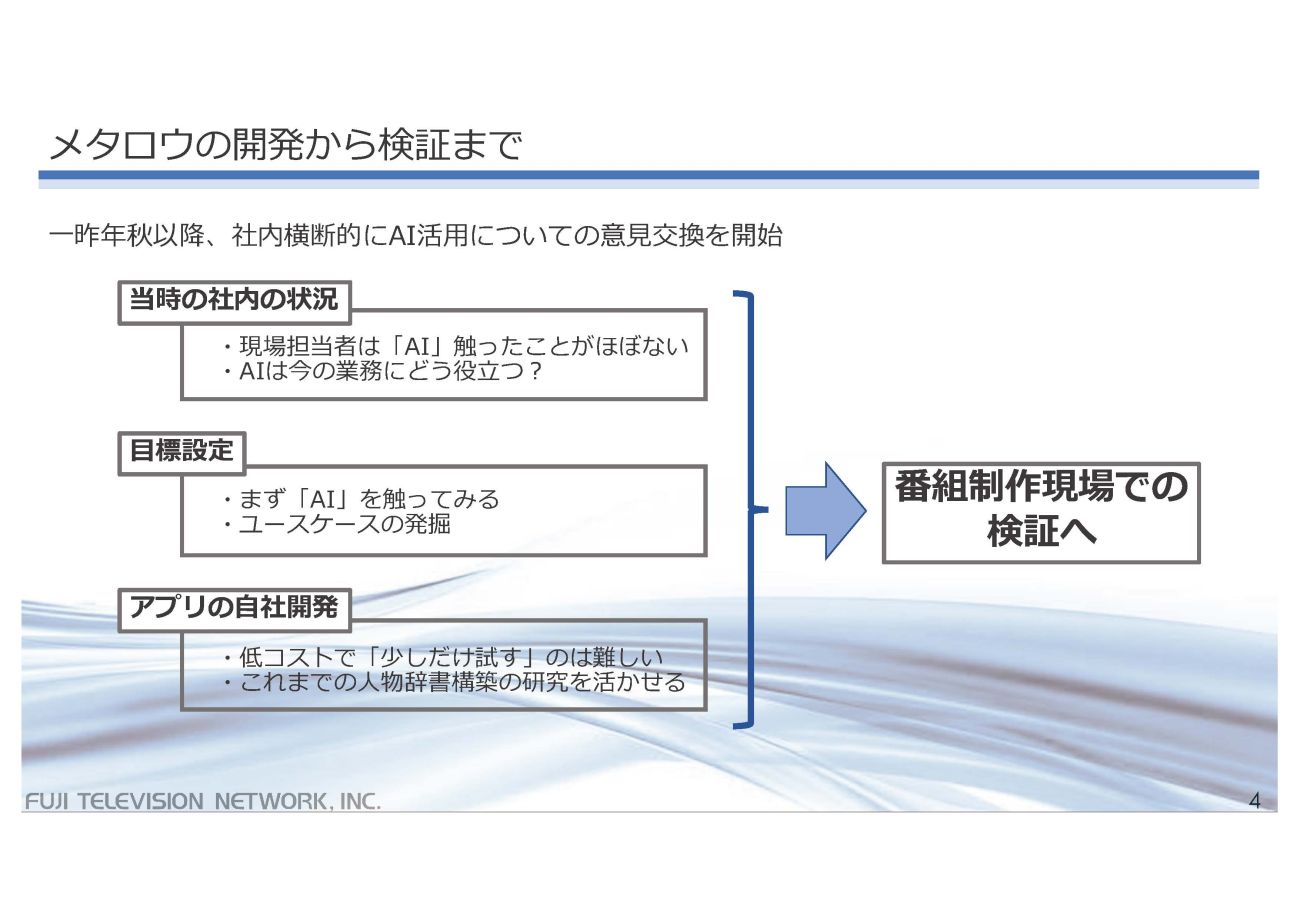

「メタロウ」は、動画や静止画を解析し、人物名を推定することが主な機能で、自社で作成した人物辞書(著名人を中心にした約16,000名を登録)を利用し、AI機能はオープンソースソフトウェアとAWSのAPIを併用。一昨年の秋から、社内検証を目的に開発がすすめられている。

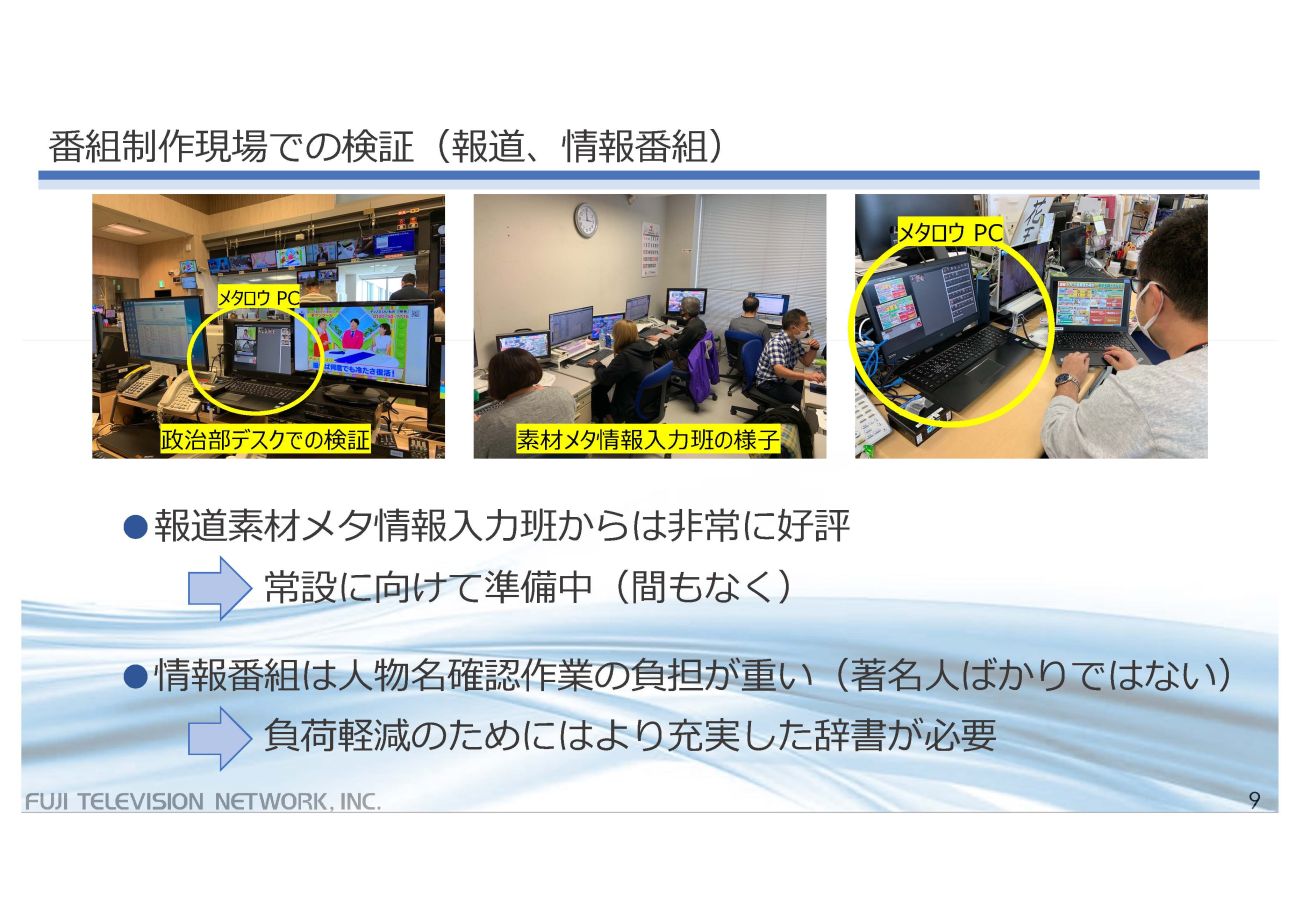

当時は、殆どの番組制作者がAIに触れたこともなく、業務への役立て方もわからない状態だったという。そこでまずは“AIに触れてユースケースを発掘すること”を目標に設定し、アプリケーションを自社開発しながら、番組の制作現場で利便性を検証することに。すると、報道素材のメタ情報の入力担当者に好評で、常設に向けて準備をすすめているという。開発においては、情報番組の登場人物は必ずしも著名人ではないため、より充実した辞書の作成が課題だとした。

今後について白坂氏は、「番組のメタデータはより重要になると考えています。まずデータを準備し、より多くのデータを自動取得できるようにするため、現場との対話が大事です」と語り、「放送アーカイブや映像素材などの幅広い利用方法を模索し、より良いコンテンツ制作に向けた活用方法の検討・検証を引き続き行っていきたい」と今後の抱負を述べ、本セッションは終了となった。